Deep Learning: comprendre et construire des réseaux de neurones

Leçon 17: Limites des RNN face au vanishing gradient et aux dépendances longues: apports des LSTM et GRU

Toutes les leçons

Deep Learning: comprendre et construire des réseaux de neurones

Leçon 17

Limites des RNN face au vanishing gradient et aux dépendances longues: apports des LSTM et GRU

Limites des RNN face au vanishing gradient et aux dépendances longues: apports des LSTM et GRU

Problématiques des RNN classiques et solutions apportées par les LSTM et GRU

Les RNN: une mémoire courte face aux longues dépendances

Les réseaux de neurones récurrents (RNN) ont constitué une avancée majeure dans le traitement des données séquentielles. Contrairement aux réseaux de neurones classiques, ils intègrent une mémoire interne qui leur permet de prendre en compte le contexte et de relier les éléments successifs d’une séquence. Cette capacité est précieuse pour des tâches comme la traduction, la reconnaissance vocale ou l’analyse de séries temporelles.Malgré cette force, les RNN présentent une faiblesse importante lorsqu’ils doivent traiter des séquences longues. Leur architecture simple ne parvient pas à maintenir efficacement l’information sur de nombreux pas temporels (time steps). En conséquence, ils retiennent bien les éléments récents, mais perdent rapidement la trace des données plus anciennes, ce qui limite leur capacité à modéliser des dépendances à long terme.

Le phénomène du vanishing gradient

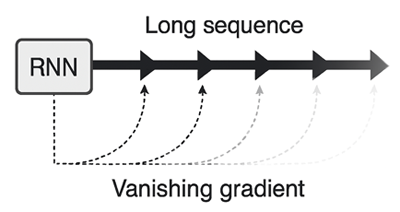

La difficulté à modéliser les longues séquences est liée à un problème mathématique lors de l’entraînement. Ce phénomène est connu sous le nom du vanishing gradient.

Pendant la rétropropagation, les gradients (qui servent à ajuster les poids du réseau) sont multipliés à chaque étape. Sur de longues séquences, ces valeurs deviennent de plus en plus petites et finissent par tendre vers zéro. Les couches ou les pas temporels éloignés cessent alors d’apprendre, car leurs mises à jour deviennent insignifiantes.

En pratique, cela signifie que les RNN classiques échouent à capturer des relations de longue portée dans les données. Ils se montrent efficaces pour des dépendances locales, mais incapables de relier des informations distantes dans une séquence. Ce problème limite fortement leur utilisation dans des contextes complexes comme l’analyse de textes longs ou la prédiction sur des séries temporelles étendues, et a motivé la création de nouvelles architectures comme les LSTM et les GRU.

En plus du problème de vanishing gradient, il existe aussi le phénomène inverse appelé exploding gradient. Dans ce cas, les gradients deviennent extrêmement grands au fil de la rétropropagation, ce qui provoque des mises à jour trop brutales des poids et rend l’apprentissage instable. Toutefois, ce problème est beaucoup moins fréquent que le vanishing gradient dans les RNN classiques et il peut généralement être atténué par des techniques comme le gradient clipping.

Pourquoi introduire les architectures LSTM et GRU

Pour dépasser les limites des RNN classiques, la communauté scientifique a cherché à concevoir des architectures capables de mieux gérer l’apprentissage sur de longues séquences. L’objectif était de résoudre le problème du vanishing gradient et de permettre aux réseaux de conserver une mémoire plus durable, tout en maintenant une stabilité dans le processus d’entraînement.C’est dans ce contexte qu’ont été introduits les Long Short-Term Memory (LSTM) et les Gated Recurrent Units (GRU). Ces modèles reprennent l’idée de base des RNN, mais y ajoutent des mécanismes internes de régulation appelés portes. Ces portes jouent un rôle essentiel car c'est elles décident quelles informations doivent être conservées, lesquelles doivent être mises à jour et lesquelles doivent être oubliées.

Grâce à cette gestion sélective du flux d’information, les LSTM et les GRU parviennent à maintenir une mémoire plus longue et à éviter que les gradients ne disparaissent trop rapidement. Ils offrent ainsi une meilleure stabilité de l’apprentissage et une capacité accrue à modéliser des dépendances complexes dans les séquences.

En pratique, ces architectures se révèlent particulièrement efficaces dans des domaines exigeants comme la traduction automatique, la reconnaissance vocale ou l’analyse de séries temporelles où la compréhension des relations à long terme est indispensable.

Dans les leçons qui vont suivre, nous allons détailler le fonctionnement des architectures LSTM et GRU. Nous verrons comment elles surmontent les limites des RNN classiques grâce à leurs mécanismes internes de régulation. Enfin, nous explorerons des exemples pratiques accompagnés de code afin de mieux comprendre leur utilisation dans des tâches réelles de traitement de séquences.

Leçon 17

Limites des RNN face au vanishing gradient et aux dépendances longues: apports des LSTM et GRU

Limites des RNN face au vanishing gradient et aux dépendances longues: apports des LSTM et GRU